La vidéo est explicite : une Tesla mise en mode autonome fonce sur un mannequin qui simule un enfant qui traverse la route. En parallèle un véhicule Lexus modifié par Luminar Technologies avec son système de LiDAR "Proactive Safety" qui, lui, s'arrête avant le mannequin. La Tesla quant à elle ? Eh bien elle éclate ledit mannequin. Le constat est sans appel : le système de conduite autonomisée de Tesla ne reconnait pas les enfants, ou les reconnait mais décide de les écraser (laissons le bénéfice du doute à Tesla...).

Ils demandent l'interdiction pure et simple du FSD

C'est le Dawn Project, un groupe d'ingénieurs et d'avocat qui a levé le lièvre. Et ils n'y vont pas avec le dos de la cuiller puisque, par la voix de Dan O'Dowd fondateur du Dawn Project, le groupe demande ni plus ni moins que l'interdiction de l'Autopilot de Tesla. "Le système de conduite autonome de Tesla est le pire logiciel commercial que j'ai jamais vu" déclare O'Dowd dans une vidéo.

Selon le Dawn Project, des dizaines de tests ont été faits avec la dernière version du "Tesla Full Self-Driving (FSD) Beta". Un mannequin de petite taille est mis en travers de la route de la voiture et elle doit théoriquement s'arrêter, ou au minimum fortement ralentir quand elle détecte le piéton. Et les tests ne se font qu'à 25 mph, soit 40 km/h, allure "faible" de zone urbaine.

O'Dowd demande donc que l'on "débranche" le FSD de Tesla tant que le constructeur n'aura pas démontré qu'il n'écrase pas les enfants qui traversent la route. Le FSD est montré du doigt car Tesla joue sur l'ambigüité. Certes Tesla prend toutes les précautions en indiquant tout le temps que le conducteur humain doit être prêt à reprendre les commandes et que son système ne peut garantir la sécurité des occupants de la voiture comme des autres usagers de la route. Cependant, en parlant d'Autopilot, de FSD (sa nouvelle mouture plus sophistiquée) ou autres sobriquets du genre, Tesla entretient la confusion dans l'esprit des gens qui pensent qu'ils peuvent aller sur le siège passager ou s'endormir au volant sans problème.

Le Dawn Project totalement neutre ?

Bon, nuançons tout de même car O'Dowd possède aussi Green Hills, une société de logiciel qui développe des systèmes de conduite autonome. Evidemment, il ne fait pas une voiture à proprement parler, mais son logiciel est à priori utilisé par d'autres sociétés concurrentes de Tesla. On attend la réponse de Tesla sur ces accusations.

Ce n'est pas la première fois que Tesla est montré du doigt ou carrément accusé de dangerosité pour ses systèmes de conduite autonomisée. A chaque fois, le constructeur semble s'en être sorti sans dommage. Mais, en juin, la National Highway Traffic Safety Administration (NHTSA, l'autorité des transports aux USA) a décidé d'étendre son enquête sur l'Autopilot à plus de 830 000 Tesla pour savoir si le système ne provoquerait pas un comportement dangereux des conducteurs, trompés (et tro confiants) par le système Tesla. Un autre point est regardé, les freinages fantômes. Un radar frontal a été retiré des dernières Tesla et cela pourrait provoquer des freinages intempestifs, menant à de potentiels accidents.

La Californie aussi a Tesla dans le viseur. Le California Department of Motor Vehicles (DMV) accuse le constructeur américain de véhicules électriques de tromper les consommateurs sur ses technologies de conduite autonome. Là encore, plus que le système en lui-même, c'est le langage utilisé qui pourrait selon le DMV tromper le consommateur qui pense que la voiture est totalement autonome.

Notre avis, par leblogauto.com

Le système FSD est actuellement en version beta, comme à la grande habitude de Tesla (sur le modèle des start up du logiciel). Musk a annoncé aux actionnaires de Tesla que le "Full Self-Driving" serait disponible d'ici la fin de l'année 2022 pour tous les possesseurs de Tesla qui en feraient la demande. Une nouvelle fois, la pression sur Tesla est énorme.

Tesla s'est bâti une réputation de "start up de la bagnole électrique" avec le software en étendard. Le système Autopilot fait partie intégrante de cette politique et le futur FSD aussi. Si le système a réellement une faille, nulle doute que cela rejaillira en partie sur les ventes et la réputation de Tesla. Les fans de Musk et de Tesla n'en auront cure et crieront sans doute au complot.

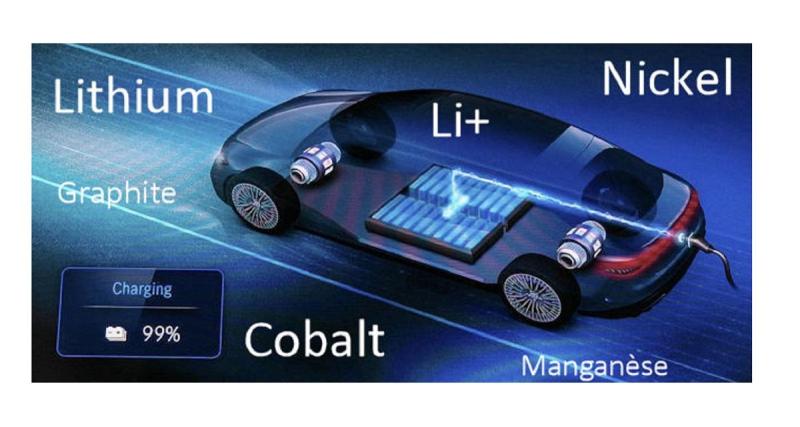

A noter que Tesla refuse pour le moment d'utiliser la technologie LiDAR (laser) et lui préfère les caméras et les RaDAR (ondes radio). Les LiDAR ont une plus grande portée et une meilleure définition. En revanche, ils coûtent plus cher à mettre en oeuvre.

![Les Tesla ne reconnaissent pas les enfants [vidéo]](https://medias.leblogauto.com/20/2022/08/photo_article/92551/174465/1200-L-les-tesla-ne-reconnaissent-pas-les-enfants.jpg)